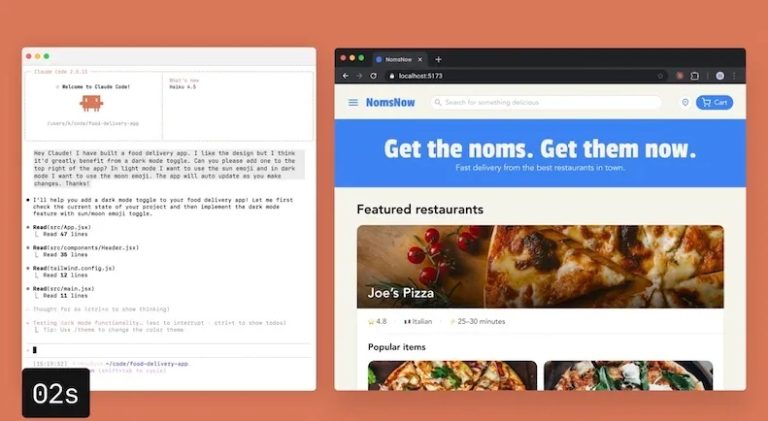

Claude 可以完成 2 万字级别的长文写作,但前提是任务被拆解、目标一致、上下文负载受控。

如果把“2 万字”当成一次性输出目标,或在同一条连续对话中无限累积内容,这个结论就不成立。

换句话说:

Claude 能写 2 万字,但不能“无管理地写 2 万字”。

一、先澄清一个误区:什么叫“写 2 万字”

很多讨论里,其实混淆了三种不同情况:

- 一次性生成 2 万字

- 单条连续对话中逐步写到 2 万字

- 分阶段、分模块完成一个总字数 2 万字的成稿

👉 结论只对第 3 种情况成立。

前两种,本身就超出了任何模型的合理使用边界。

二、Claude 写 2 万字“成立”的核心条件

从真实输出表现来看,Claude 写长文是否可行,取决于三个关键条件。

1️⃣ 写作目标必须是“稳定且单一的”

Claude 在长文任务中,最怕的不是字数,而是目标漂移。

当长文满足以下特征时,可行性显著提高:

- 主题单一、不频繁转向

- 写作角色不切换(例如不一会儿教程、一会儿评论)

- 判断标准始终一致

一旦在中后段引入新的写作目标,Claude 会优先保证一致性,而不是强行扩展内容。

2️⃣ 长文必须被拆成“逻辑模块”

2 万字在 Claude 看来,不是一个整体,而是一组模块。

成立的结构通常是:

- 每个模块是一个可独立判断的问题

- 模块之间存在清晰的逻辑顺序

- 单模块文本量可控(而不是无限延伸)

如果模块本身已经失控(例如一个章节内部无限扩写),质量衰减会提前出现。

3️⃣ 上下文不能无限累积

Claude 的长文能力,建立在**“有效上下文仍然可被完整理解”**的前提下。

当上下文负载过重时,它会:

- 优先保留主线结论

- 简化细节

- 降低信息密度

这不是失败,而是主动取舍。

因此,长文写作本质上不是“记忆挑战”,而是“上下文管理问题”。

三、Claude 在 2 万字任务中的真实表现特征

在满足上述条件时,Claude 的行为模式非常稳定:

- 不会在后半段突然偏离主题

- 不会出现明显的风格断裂

- 结论立场前后一致

- 章节之间逻辑衔接自然

但同时也会出现一个明显特征:

越靠后,表达越克制,越少“额外发挥”。

这意味着:

- 它更偏向完成任务

- 而不是不断“加料”

四、哪些情况下,“Claude 写 2 万字”这个命题不成立?

为了避免结论被误用,这些失败场景必须明确:

- 试图在一条对话中连续堆叠全文

- 不断回滚、修改、插入旧段落

- 写作过程中频繁改变风格或立场

- 把 Claude 当成“无限上下文编辑器”

在这些情况下:

- 不是 Claude 不行

- 而是任务设计本身不可行

五、与 ChatGPT 的差异(只谈长文)

在“是否能完成 2 万字长文”这一点上,两者的核心差异不是字数上限,而是衰减方式:

- Claude:

- 表现为渐进式收敛

- 更少出现结构性跑题

- ChatGPT:

- 更容易在后段出现风格与目标漂移

- 需要更频繁地纠偏

因此,在需要整体一致性的长文任务中,Claude 的可控性更高。

从根本上看,这仍然回到 Claude 写作能力本身的边界判断,详见 《Claude 写作能力到底强在哪?》。